เช็คก่อนแชร์! AI ‘ตาสับปะรด’ จับโป๊ะข่าวปลอม

- ประเด็นสำคัญที่น่าสนใจ

- ทำความรู้จัก AI ‘ตาสับปะรด’ เครื่องมือสำคัญในยุคข้อมูลข่าวสาร

- เบื้องหลังการทำงานและพัฒนาการของ AI ‘ตาสับปะรด’

- AI กับการต่อสู้ข่าวปลอมในหลากหลายมิติ

- บทบาทขององค์กรสื่อและแพลตฟอร์มโซเชียลมีเดีย

- เปรียบเทียบแนวทางการตรวจสอบข่าวปลอมของระบบต่างๆ

- ความท้าทายและอนาคตของการใช้ AI ตรวจข่าวปลอม

- บทสรุป: สร้างเกราะป้องกันข่าวปลอมด้วยเทคโนโลยีและวิจารณญาณ

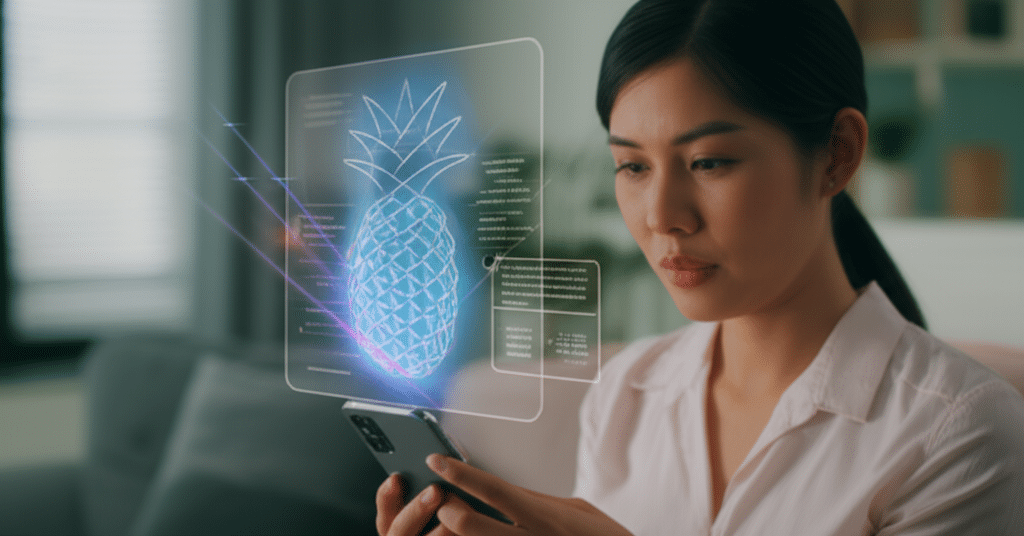

ในยุคดิจิทัลที่ข้อมูลข่าวสารสามารถแพร่กระจายได้อย่างรวดเร็วและไร้ขีดจำกัด การตรวจสอบความถูกต้องของข้อมูลก่อนเชื่อและแชร์ต่อกลายเป็นทักษะที่จำเป็นอย่างยิ่ง ด้วยเหตุนี้ การมาถึงของเครื่องมืออย่าง เช็คก่อนแชร์! AI ‘ตาสับปะรด’ จับโป๊ะข่าวปลอม จึงเปรียบเสมือนผู้ช่วยคนสำคัญที่เข้ามาเสริมสร้างความแข็งแกร่งให้กับสังคมออนไลน์ในการรับมือกับปัญหาข่าวปลอม (Fake News) ที่ทวีความรุนแรงและซับซ้อนมากขึ้นทุกวัน

ประเด็นสำคัญที่น่าสนใจ

- ตาสับปะรด AI เป็นแชทบอทและส่วนขยายเบราว์เซอร์ที่พัฒนาโดยกระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (ดีอีเอส) เพื่อช่วยให้ประชาชนสามารถตรวจสอบความน่าเชื่อถือของข่าวสารบนโซเชียลมีเดียได้แบบเรียลไทม์

- เทคโนโลยีปัญญาประดิษฐ์ (AI) มีบทบาทสำคัญในการวิเคราะห์และตรวจจับข่าวปลอมหลากหลายรูปแบบ ตั้งแต่ข่าวลวงเกี่ยวกับสถานการณ์โควิด-19 ไปจนถึงเนื้อหาที่สร้างขึ้นโดย AI เช่น ภาพและวิดีโอ Deepfake

- องค์กรสื่อและแพลตฟอร์มออนไลน์ชั้นนำ เช่น Thai PBS Verify และ TikTok ได้นำระบบ AI มาใช้ร่วมกับการตรวจสอบโดยมนุษย์ เพื่อเพิ่มความแม่นยำและประสิทธิภาพในการคัดกรองข้อมูลเท็จ

- แม้ AI จะเป็นเครื่องมือที่มีประสิทธิภาพสูง แต่การตระหนักรู้และใช้วิจารณญาณของผู้ใช้งานยังคงเป็นปัจจัยสำคัญที่สุดในการหยุดยั้งการแพร่ระบาดของข่าวปลอม

- การต่อสู้กับข่าวปลอมเป็นการแข่งขันทางเทคโนโลยีที่ไม่สิ้นสุด เนื่องจากผู้สร้างข่าวปลอมก็มีการพัฒนาเครื่องมือและวิธีการที่ซับซ้อนมากขึ้นเช่นกัน

ทำความรู้จัก AI ‘ตาสับปะรด’ เครื่องมือสำคัญในยุคข้อมูลข่าวสาร

เช็คก่อนแชร์! AI ‘ตาสับปะรด’ จับโป๊ะข่าวปลอม คือระบบปัญญาประดิษฐ์ที่ถูกพัฒนาขึ้นเพื่อเป็นเครื่องมือในการตรวจสอบและคัดกรองข่าวสารในโลกออนไลน์ โดยมีวัตถุประสงค์หลักเพื่อลดการแพร่กระจายของข้อมูลเท็จที่อาจสร้างความเสียหายต่อสังคมและเศรษฐกิจในวงกว้าง การเกิดขึ้นของเครื่องมือนี้สะท้อนให้เห็นถึงความพยายามของภาครัฐ โดยเฉพาะกระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (ดีอีเอส) ในการแก้ไขปัญหาข่าวปลอมอย่างจริงจัง

ในยุคที่โซเชียลมีเดียกลายเป็นช่องทางหลักในการรับและส่งต่อข้อมูล ข่าวปลอมสามารถแพร่กระจายไปได้อย่างรวดเร็วเพียงปลายนิ้วสัมผัส ผลกระทบของมันมีตั้งแต่การสร้างความเข้าใจผิดในเรื่องสุขภาพ เช่น ข้อมูลที่ไม่ถูกต้องเกี่ยวกับโควิด-19 ไปจนถึงการหลอกลวงทางการเงิน และการสร้างความแตกแยกในสังคม ดังนั้น การมีเครื่องมือที่ช่วยให้ผู้ใช้งานสามารถตรวจสอบข้อมูลเบื้องต้นได้ทันทีจึงเป็นสิ่งจำเป็นอย่างยิ่ง ‘ตาสับปะรด AI’ ถูกออกแบบมาเพื่อตอบสนองต่อความต้องการนี้ โดยทำหน้าที่เป็นเสมือนผู้ช่วยคัดกรองที่ทำงานตลอด 24 ชั่วโมง

เบื้องหลังการทำงานและพัฒนาการของ AI ‘ตาสับปะรด’

หัวใจสำคัญของ ‘ตาสับปะรด AI’ คือเทคโนโลยีปัญญาประดิษฐ์ที่ถูกฝึกฝนให้เข้าใจและวิเคราะห์ภาษาไทยโดยเฉพาะ ซึ่งเป็นความท้าทายอย่างมากเนื่องจากความซับซ้อนของภาษาและบริบททางวัฒนธรรม

หลักการทำงาน: การวิเคราะห์ภาษาไทยและความน่าจะเป็น

ระบบ AI ของ ‘ตาสับปะรด’ ทำงานโดยใช้เทคนิคการประมวลผลภาษาธรรมชาติ (Natural Language Processing – NLP) เพื่อวิเคราะห์ข้อความ ข่าว หรือโพสต์ที่ผู้ใช้ส่งเข้ามาตรวจสอบ จากนั้น AI จะทำการประเมินองค์ประกอบต่างๆ เช่น รูปแบบการใช้ภาษา, แหล่งที่มาของข้อมูล (หากมี), และการเปรียบเทียบกับฐานข้อมูลข่าวจริงและข่าวปลอมที่เคยรวบรวมไว้

ผลลัพธ์ที่ได้จะไม่ใช่การตัดสินว่า “จริง” หรือ “ปลอม” แบบ 100% แต่จะเป็นการประเมิน ความน่าจะเป็น ของการเป็นข่าวปลอมออกมาเป็นค่าคะแนน เพื่อเป็นข้อมูลประกอบการตัดสินใจของผู้ใช้งาน วิธีการนี้ช่วยให้ผู้ใช้เกิดความตระหนักและฉุกคิดก่อนที่จะเชื่อหรือแชร์ข้อมูลนั้นๆ ต่อไป ซึ่งเป็นการส่งเสริมทักษะความรอบรู้ด้านดิจิทัล (Digital Literacy) ไปในตัว

จากโครงการวิจัยสู่เครื่องมือสำหรับประชาชน

‘ตาสับปะรด AI’ ไม่ได้เกิดขึ้นจากความว่างเปล่า แต่เป็นผลผลิตจากโครงการวิจัยต้นแบบที่มุ่งเน้นการพัฒนา AI เพื่อเรียนรู้และทำความเข้าใจภาษาไทยอย่างลึกซึ้ง การพัฒนานี้ต้องใช้ข้อมูลจำนวนมหาศาลในการฝึกฝน (Training) เพื่อให้ AI สามารถแยกแยะความแตกต่างระหว่างการนำเสนอข่าวที่เป็นกลางและมีแหล่งอ้างอิง กับเนื้อหาที่มีลักษณะชี้นำ สร้างความตื่นตระหนก หรือขาดความน่าเชื่อถือ การเปิดตัวในรูปแบบของแชทบอทและส่วนขยายเบราว์เซอร์ (Browser Extension) ทำให้ประชาชนทั่วไปสามารถเข้าถึงเทคโนโลยีนี้ได้อย่างง่ายดายและสะดวกสบายในชีวิตประจำวัน

AI กับการต่อสู้ข่าวปลอมในหลากหลายมิติ

ปัญหาข่าวปลอมมีการเปลี่ยนแปลงรูปแบบและพัฒนาความซับซ้อนอยู่ตลอดเวลา ทำให้เทคโนโลยี AI ที่ใช้ในการตรวจสอบต้องปรับตัวและพัฒนาตามไปด้วย จากเดิมที่เน้นตรวจสอบข่าวสารประเภทข้อความเป็นหลัก ปัจจุบัน AI ต้องรับมือกับภัยคุกคามรูปแบบใหม่ๆ ที่มีความแนบเนียนและตรวจจับได้ยากขึ้น

การรับมือคอนเทนต์ที่สร้างโดย AI: ภัยคุกคามรูปแบบใหม่

การมาถึงของ Generative AI ทำให้การสร้างเนื้อหาปลอมทำได้ง่ายและสมจริงอย่างไม่เคยเป็นมาก่อน ไม่ว่าจะเป็นภาพนิ่งที่สร้างจาก AI หรือวิดีโอ Deepfake ที่สามารถปลอมแปลงใบหน้าและเสียงของบุคคลได้อย่างแนบเนียน คอนเทนต์เหล่านี้กลายเป็นเครื่องมือชั้นดีของมิจฉาชีพและผู้ไม่หวังดีในการสร้างข่าวปลอมเพื่อหลอกลวงหรือโจมตีบุคคลอื่น

เทคโนโลยี AI ตรวจข่าวปลอม จึงต้องพัฒนาขีดความสามารถให้สามารถวิเคราะห์และตรวจจับความผิดปกติในไฟล์มีเดียเหล่านี้ได้ เช่น การวิเคราะห์พิกเซลของภาพ, ความไม่สอดคล้องกันของแสงเงา, หรือรูปแบบเสียงที่ผิดธรรมชาติ ซึ่งเป็นสมรภูมิทางเทคโนโลยีที่ทั้งฝ่ายสร้างและฝ่ายตรวจจับต้องแข่งขันกันตลอดเวลา

กรณีศึกษา: การใช้ Deepfake หลอกลวงเพื่อการลงทุน

หนึ่งในตัวอย่างที่ชัดเจนของภัยจาก Deepfake คือการสร้างคลิปวิดีโอปลอมโดยแอบอ้างเป็นผู้ประกาศข่าวหรือนักธุรกิจชื่อดัง เพื่อชักชวนให้ลงทุนในแพลตฟอร์มที่ไม่มีอยู่จริง เช่น โฆษณาชวนเชื่อชื่อ “CRYSTALLUM AI” ที่ถูกเปิดโปงโดยศูนย์ตรวจสอบข่าวปลอมอย่าง Thai PBS Verify วิดีโอเหล่านี้มักถูกสร้างขึ้นอย่างมืออาชีพ ทำให้แยกแยะได้ยากด้วยตาเปล่า และสร้างความเสียหายทางการเงินให้กับผู้ที่หลงเชื่อเป็นจำนวนมาก

กรณีเช่นนี้แสดงให้เห็นว่า การตรวจสอบข่าวปลอมไม่ได้จำกัดอยู่แค่การอ่านข้อความอีกต่อไป แต่ยังรวมถึงการวิเคราะห์เนื้อหามัลติมีเดียด้วย ซึ่งระบบ AI ตรวจข่าวปลอม รุ่นใหม่ๆ จำเป็นต้องมีฟังก์ชันเหล่านี้เพื่อรับมือกับภัยคุกคามที่ซับซ้อนขึ้น

บทบาทขององค์กรสื่อและแพลตฟอร์มโซเชียลมีเดีย

นอกเหนือจากเครื่องมือที่พัฒนาโดยภาครัฐแล้ว องค์กรสื่อและแพลตฟอร์มโซเชียลมีเดียต่างๆ ก็มีบทบาทสำคัญอย่างยิ่งในการต่อสู้กับข่าวปลอม โดยหลายแห่งได้นำเทคโนโลยี AI มาปรับใช้ในกระบวนการทำงานของตนเอง

Thai PBS Verify: การผสานเทคโนโลยีและการตรวจสอบโดยมนุษย์

Thai PBS Verify ซึ่งเป็นหน่วยงานตรวจสอบข้อเท็จจริงที่มีชื่อเสียง ได้นำระบบ AI เข้ามาช่วยในการคัดกรองและวิเคราะห์ข้อมูลเบื้องต้น อย่างไรก็ตาม จุดเด่นของพวกเขาคือการใช้แนวทางแบบผสมผสาน (Hybrid Approach) โดยมีทีมผู้ตรวจสอบที่เป็นมนุษย์คอยทำหน้าที่ยืนยันความถูกต้องในขั้นตอนสุดท้าย เพื่อให้เกิดความแม่นยำสูงสุด

นอกจากนี้ พวกเขายังมีมาตรการเชิงป้องกัน เช่น การติดป้ายกำกับ (Labeling) แจ้งเตือนข้อมูลที่ยังไม่ผ่านการยืนยันอย่างเป็นทางการ ตัวอย่างเช่น การแชร์ผลคะแนนเลือกตั้งที่ยังไม่เป็นทางการ เพื่อป้องกันไม่ให้ข้อมูลที่ยังไม่สมบูรณ์ถูกนำไปตีความและสร้างความเข้าใจผิด

มาตรการเชิงรุกของ TikTok ในการคัดกรองเนื้อหา

ในฐานะแพลตฟอร์มวิดีโอสั้นที่ได้รับความนิยมสูง TikTok ได้พัฒนาระบบคัดกรองเนื้อหาที่ใช้ AI เป็นแกนหลักทำงานร่วมกับผู้ตรวจสอบที่เป็นมนุษย์เช่นกัน ระบบของ TikTok มีความสามารถในการลบเนื้อหาที่ละเมิดกฎของชุมชนได้ในอัตราที่สูงมาก โดยข้อมูลระบุว่ากว่า 99.5% ของเนื้อหาที่ผิดกฎถูกลบออกไปก่อนที่จะมีผู้ใช้งานรายงานเข้ามาเสียอีก

ยิ่งไปกว่านั้น TikTok ยังมีการแสดงป้ายกำกับบนเนื้อหาที่ยังไม่สามารถยืนยันความถูกต้องได้ และให้ข้อมูลเพิ่มเติมจากหน่วยงานที่เชื่อถือได้ เพื่อช่วยให้ผู้ใช้สามารถเข้าถึงข้อมูลที่ถูกต้องและตัดสินใจได้อย่างมีวิจารณญาณมากขึ้น

เปรียบเทียบแนวทางการตรวจสอบข่าวปลอมของระบบต่างๆ

| ระบบ / องค์กร | เทคโนโลยีหลัก | การมีส่วนร่วมของมนุษย์ | รูปแบบการทำงาน |

|---|---|---|---|

| ตาสับปะรด AI | AI วิเคราะห์ภาษาไทย (NLP) | มีน้อย (เน้นระบบอัตโนมัติ) | ประเมินความน่าจะเป็นของข่าวปลอมเป็นคะแนนให้ผู้ใช้ตัดสินใจ (Reactive) |

| Thai PBS Verify | AI และเครื่องมือสืบค้น | สูง (เป็นผู้ตรวจสอบและยืนยันขั้นสุดท้าย) | การตรวจสอบเชิงลึก, การติดป้ายข้อมูลที่ยังไม่ยืนยัน (Proactive & Reactive) |

| TikTok | AI และ Machine Learning | สูง (ทำงานร่วมกับ AI ในการคัดกรอง) | ลบเนื้อหาที่ผิดกฎอัตโนมัติ, ติดป้ายกำกับเนื้อหาที่ไม่ยืนยัน (Proactive) |

ความท้าทายและอนาคตของการใช้ AI ตรวจข่าวปลอม

แม้ว่า AI จะเป็นเครื่องมือที่มีศักยภาพสูง แต่การต่อสู้กับข่าวปลอมยังคงมีความท้าทายอีกมาก ผู้สร้างข่าวปลอมมีการเรียนรู้และปรับเปลี่ยนกลยุทธ์อยู่เสมอ พวกเขาอาจใช้ภาษาที่กำกวม, ผสมข้อมูลจริงกับเท็จ, หรือใช้เทคนิคทางจิตวิทยาเพื่อทำให้เนื้อหาดูน่าเชื่อถือมากขึ้น ทำให้ AI ต้องได้รับการอัปเดตและฝึกฝนด้วยข้อมูลใหม่ๆ อย่างต่อเนื่อง

อนาคตของการตรวจจับข่าวปลอมจึงน่าจะมุ่งไปที่การพัฒนา AI ที่มีความสามารถในการเข้าใจบริบท (Contextual Understanding) ที่ลึกซึ้งยิ่งขึ้น สามารถวิเคราะห์เครือข่ายการแพร่กระจายของข้อมูล และทำงานร่วมกับมนุษย์ได้อย่างไร้รอยต่อมากขึ้น อย่างไรก็ตาม ปัจจัยที่สำคัญที่สุดยังคงเป็นการสร้างความตระหนักรู้และส่งเสริมทักษะการคิดวิเคราะห์ให้กับผู้ใช้งานทุกคน

บทสรุป: สร้างเกราะป้องกันข่าวปลอมด้วยเทคโนโลยีและวิจารณญาณ

การเปิดตัว ‘ตาสับปะรด AI’ และความพยายามขององค์กรต่างๆ ในการใช้เทคโนโลยีปัญญาประดิษฐ์เพื่อต่อสู้กับข่าวปลอม ถือเป็นก้าวสำคัญในการสร้างสภาพแวดล้อมออนไลน์ที่ปลอดภัยและน่าเชื่อถือมากขึ้น เครื่องมือเหล่านี้ช่วยลดภาระของผู้ใช้งานในการตรวจสอบข้อมูลเบื้องต้นและเพิ่มความระมัดระวังก่อนการแชร์

อย่างไรก็ตาม เทคโนโลยีเป็นเพียงเครื่องมือสนับสนุนเท่านั้น เกราะป้องกันข่าวปลอมที่แข็งแกร่งที่สุดคือวิจารณญาณของผู้รับสารเอง การตั้งคำถามต่อข้อมูลที่ได้รับ, การตรวจสอบแหล่งที่มา, การเปรียบเทียบข้อมูลจากหลายๆ แหล่ง และการใช้เครื่องมืออย่าง ‘ตาสับปะรด AI’ ควบคู่กันไป จะเป็นแนวทางที่มีประสิทธิภาพที่สุดในการหยุดยั้งวงจรของข่าวปลอม และสร้างสังคมดิจิทัลที่มีคุณภาพและยั่งยืนต่อไป การ เช็คข่าวจริง ก่อนแชร์ทุกครั้ง คือความรับผิดชอบร่วมกันของทุกคน