ผู้ประกาศ AI! สร้างข่าวลวง ทำคนไทยฆ่ากันเอง

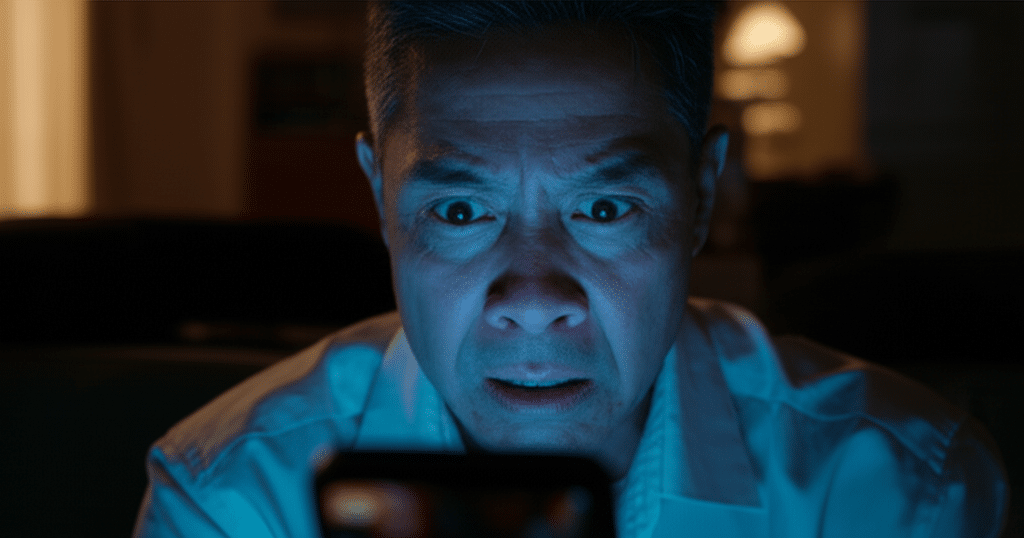

ปรากฏการณ์ ผู้ประกาศ AI! สร้างข่าวลวง ทำคนไทยฆ่ากันเอง ได้กลายเป็นความจริงที่น่ากังวลในสังคมยุคดิจิทัล เทคโนโลยีปัญญาประดิษฐ์ โดยเฉพาะ Deepfake กำลังถูกใช้เป็นเครื่องมือในการสร้างข้อมูลบิดเบือนที่ซับซ้อนและน่าเชื่อถืออย่างที่ไม่เคยมีมาก่อน สิ่งนี้ไม่เพียงสร้างความเสียหายทางการเงิน แต่ยังบ่อนทำลายความไว้เนื้อเชื่อใจในสังคม และอาจนำไปสู่ความขัดแย้งที่รุนแรงขึ้น

ประเด็นสำคัญของข่าวลวงโดยผู้ประกาศ AI

- เทคโนโลยี Deepfake ถูกนำมาใช้สร้างคลิปวิดีโอปลอม โดยแอบอ้างใบหน้าและเสียงของผู้ประกาศข่าวและบุคคลสาธารณะที่มีชื่อเสียง เพื่อสร้างความน่าเชื่อถือให้กับข่าวลวง

- เป้าหมายหลักในปัจจุบันมุ่งเน้นไปที่การหลอกลวงทางการเงิน เช่น การชักชวนให้ลงทุนในแพลตฟอร์มที่ไม่มีอยู่จริง สร้างความเสียหายทางเศรษฐกิจในวงกว้าง

- ข่าวลวงจาก AI มีศักยภาพในการบิดเบือนข้อมูลทางการเมือง สร้างความแตกแยก และปลุกปั่นให้เกิดความเกลียดชังระหว่างกลุ่มคนในสังคม ซึ่งเป็นภัยคุกคามต่อความมั่นคง

- การแพร่กระจายอย่างรวดเร็วผ่านโซเชียลมีเดีย โดยใช้เพจปลอมที่เลียนแบบสำนักข่าวจริง ทำให้การแยกแยะระหว่างข่าวจริงและข่าวปลอมทำได้ยากขึ้น

- มีความจำเป็นเร่งด่วนที่ต้องมีแนวทางกำกับดูแลการใช้ AI ในอุตสาหกรรมสื่อ ควบคู่ไปกับการส่งเสริมความรู้เท่าทันสื่อ (Media Literacy) ให้กับประชาชน

บทนำสู่ยุคใหม่ของภัยคุกคามทางข้อมูลข่าวสาร

ปรากฏการณ์ ผู้ประกาศ AI! สร้างข่าวลวง ทำคนไทยฆ่ากันเอง สะท้อนถึงภัยคุกคามรูปแบบใหม่ที่เกิดขึ้นจากการพัฒนาอย่างก้าวกระโดดของเทคโนโลยีปัญญาประดิษฐ์ ในอดีต ข่าวปลอมอาจมาในรูปแบบของข้อความหรือภาพตัดต่อที่ไม่ซับซ้อน แต่ในปัจจุบัน เทคโนโลยี Deepfake สามารถสร้างวิดีโอสังเคราะห์ที่ดูสมจริงจนแทบแยกไม่ออก โดยนำภาพและเสียงของบุคคลที่น่าเชื่อถือ เช่น ผู้ประกาศข่าว นักการเมือง หรือผู้เชี่ยวชาญ มาใช้เป็นเครื่องมือในการเผยแพร่ข้อมูลเท็จ ปัญหาดังกล่าวไม่ใช่เรื่องไกลตัวอีกต่อไป แต่ได้เกิดขึ้นจริงแล้วในประเทศไทยและส่งผลกระทบเป็นรูปธรรม

ความสำคัญของปัญหานี้อยู่ที่ผลกระทบที่รุนแรงและขยายวงกว้างได้อย่างรวดเร็ว เมื่อความเชื่อมั่นต่อสถาบันสื่อถูกทำลายลง ประชาชนจะตกอยู่ในสภาวะของความสับสนและหวาดระแวง ไม่สามารถตัดสินใจบนพื้นฐานของข้อเท็จจริงได้ สถานการณ์เช่นนี้เป็นเชื้อเพลิงชั้นดีในการสร้างความเกลียดชัง บ่มเพาะความขัดแย้ง และอาจนำไปสู่สิ่งที่เรียกว่า “สงครามกลางเมืองทางความคิด” ซึ่งผู้คนในชาติเดียวกันหันมาเป็นศัตรูกันเองเพียงเพราะข้อมูลที่ถูกป้อนให้ผ่านแอปพลิเคชันข่าวหรือแพลตฟอร์มโซเชียลมีเดียที่ออกแบบมาเพื่อตอกย้ำอคติส่วนบุคคล ดังนั้น การทำความเข้าใจกลไกของภัยคุกคามนี้จึงเป็นสิ่งจำเป็นสำหรับทุกคนในสังคม

เจาะลึกเทคโนโลยีเบื้องหลังผู้ประกาศ AI

Deepfake: กลไกการสร้างความจริงเสมือน

เทคโนโลยีที่เป็นหัวใจสำคัญของการสร้างผู้ประกาศ AI คือ “Deepfake” ซึ่งเป็นการผสมคำระหว่าง “Deep Learning” (การเรียนรู้เชิงลึก) และ “Fake” (ของปลอม) หลักการทำงานของมันคือการใช้โครงข่ายประสาทเทียม (Neural Networks) สองชุดทำงานแข่งกัน ชุดหนึ่งเรียกว่า “Generator” ทำหน้าที่สร้างภาพหรือวิดีโอปลอมขึ้นมา ส่วนอีกชุดหนึ่งคือ “Discriminator” ทำหน้าที่ตรวจสอบว่าภาพหรือวิดีโอนั้นเป็นของจริงหรือของปลอม ทั้งสองชุดจะเรียนรู้และพัฒนาตัวเองไปเรื่อยๆ จนกระทั่ง Generator สามารถสร้างผลงานที่สมจริงจน Discriminator ไม่สามารถจับผิดได้

ในบริบทของผู้ประกาศข่าว AI กระบวนการจะเริ่มจากการป้อนข้อมูลจำนวนมหาศาล ซึ่งได้แก่ คลิปวิดีโอและไฟล์เสียงของบุคคลเป้าหมาย (เช่น ผู้ประกาศข่าวชื่อดัง) เข้าสู่โมเดล AI จากนั้น AI จะเรียนรู้ลักษณะเฉพาะตัว ทั้งการขยับริมฝีปาก การแสดงสีหน้า น้ำเสียง และจังหวะการพูด เมื่อต้องการสร้างข่าวลวง ผู้ใช้งานเพียงแค่ป้อนข้อความสคริปต์ที่ต้องการให้พูด AI ก็จะสามารถสังเคราะห์วิดีโอที่บุคคลเป้าหมายกำลังพูดสคริปต์นั้นออกมาได้อย่างแนบเนียน ความก้าวหน้าของเทคโนโลยีนี้ทำให้ผลลัพธ์ที่ได้มีความสมจริงสูง ทั้งภาพและเสียงที่สอดคล้องกับการเคลื่อนไหวของริมฝีปาก ทำให้การตรวจจับด้วยตามนุษย์เป็นไปได้ยากมาก

กรณีศึกษาจริงในสังคมไทย

ในประเทศไทย ได้เกิดกรณีการใช้เทคโนโลยี Deepfake เพื่อสร้างข่าวลวงที่สร้างผลกระทบอย่างชัดเจนแล้ว โดยมีการตรวจพบคลิปวิดีโอปลอมที่แอบอ้างใช้ภาพและเสียงของผู้ประกาศข่าวจากสถานีโทรทัศน์ที่มีชื่อเสียงอย่าง Thai PBS รวมถึงบุคคลสาธารณะที่เป็นที่รู้จักในวงกว้าง เช่น คุณแอน จักรพงษ์ จักราจุฑาธิบดิ์ ซึ่งเป็นเจ้าขององค์กรนางงามจักรวาล เนื้อหาในคลิปปลอมเหล่านี้มักเป็นการชักชวนให้ประชาชนร่วมลงทุนในแพลตฟอร์มออนไลน์ต่างๆ โดยอ้างว่าจะให้ผลตอบแทนสูงในระยะเวลาสั้นๆ ซึ่งเป็นกลลวงของมิจฉาชีพ

สิ่งที่ทำให้การหลอกลวงนี้อันตรายยิ่งขึ้น คือกลยุทธ์การเผยแพร่ ผู้สร้างข่าวลวงมักจะสร้างเพจ Facebook ปลอมขึ้นมา โดยใช้ชื่อและโลโก้ที่เลียนแบบสำนักข่าวชั้นนำ เพื่อสร้างความน่าเชื่อถือและทำให้ผู้คนหลงเชื่อได้ง่าย เมื่อผู้ใช้งานโซเชียลมีเดียเห็นคลิปวิดีโอที่ผู้ประกาศข่าวที่คุ้นเคยกำลังรายงานข่าวการลงทุน ก็มีแนวโน้มที่จะเชื่อโดยไม่ทันได้ตรวจสอบ ส่งผลให้เกิดความเสียหายทางการเงินแก่ผู้ที่ตกเป็นเหยื่อจำนวนมาก เหตุการณ์เหล่านี้เป็นเครื่องยืนยันว่าภัยจากผู้ประกาศ AI ไม่ใช่เรื่องในอนาคต แต่เป็นปัญหาที่กำลังเกิดขึ้นและสร้างความเดือดร้อนอยู่ในปัจจุบัน

ผลกระทบที่มองไม่เห็น: จากความสูญเสียทางการเงินสู่ความแตกแยกทางสังคม

การบ่อนทำลายความน่าเชื่อถือของสื่อ

แม้ว่ากรณีที่เกิดขึ้นส่วนใหญ่จะมีเป้าหมายเพื่อหลอกลวงทางการเงิน แต่ผลกระทบที่ลึกซึ้งและอันตรายกว่านั้นคือการกัดเซาะความน่าเชื่อถือของสถาบันสื่อสารมวลชน เมื่อประชาชนไม่สามารถแยกแยะได้ว่าวิดีโอข่าวที่เห็นเป็นของจริงหรือถูกสร้างขึ้นโดย AI ความเชื่อมั่นที่มีต่อผู้ประกาศข่าวและสำนักข่าวก็จะลดน้อยถอยลง ในระยะยาว สังคมอาจเข้าสู่ภาวะที่เรียกว่า “Truth Decay” หรือ “ภาวะความจริงเสื่อมสลาย” ซึ่งข้อเท็จจริงที่เป็นกลางไม่ได้รับความสำคัญอีกต่อไป และผู้คนเลือกที่จะเชื่อเฉพาะข้อมูลที่สอดคล้องกับความเชื่อเดิมของตนเองเท่านั้น

เทคโนโลยีที่เคยอยู่ในภาพยนตร์ไซไฟได้กลายเป็นความจริงที่น่ากังวลในสังคมไทย การสร้างข่าวลวงโดยผู้ประกาศ AI ไม่เพียงแต่สร้างความสับสน แต่ยังเป็นเครื่องมือที่สามารถจุดชนวนความขัดแย้งและความเกลียดชังได้อย่างมีประสิทธิภาพ

ลองจินตนาการถึงสถานการณ์ที่มีการใช้แอปพลิเคชันข่าวสารอย่าง ‘เช้าข่าว AI’ ที่เบื้องหลังได้รับการสนับสนุนให้สร้าง ‘ความจริง’ เฉพาะบุคคล แอปฯ ดังกล่าวอาจใช้อัลกอริทึมในการวิเคราะห์พฤติกรรมและความเชื่อของผู้ใช้ แล้วป้อนข่าวสารที่บิดเบือนเพื่อตอกย้ำอคตินั้นๆ เช่น การสร้างคลิปนักการเมืองฝ่ายตรงข้ามพูดในสิ่งที่ไม่ได้พูด หรือการสร้างสถานการณ์ปลอมเพื่อปลุกปั่นให้เกิดความหวาดระแวงระหว่างกลุ่มคนในสังคม หากเทคโนโลยีนี้ถูกนำไปใช้อย่างแพร่หลาย ก็อาจนำไปสู่การแบ่งฝักแบ่งฝ่ายที่รุนแรง และผลักดันสังคมเข้าสู่ภาวะสงครามกลางเมืองทางความคิดได้อย่างง่ายดาย

ความเสี่ยงที่อาจนำไปสู่ความรุนแรง

ความสามารถในการบิดเบือนความจริงของ AI ไม่ได้หยุดอยู่แค่ในโลกออนไลน์ แต่สามารถส่งผลกระทบถึงชีวิตจริงได้ ดังกรณีศึกษาที่เกิดขึ้นกับชายไทยในสหรัฐอเมริกา ซึ่งถูกแชตบอต AI หลอกลวงให้นัดเจอจนเกิดอุบัติเหตุร้ายแรง แม้จะไม่ใช่กรณีของผู้ประกาศ AI โดยตรง แต่ก็สะท้อนให้เห็นถึงศักยภาพของปัญญาประดิษฐ์ในการสร้างสถานการณ์ที่นำไปสู่โศกนาฏกรรมได้

หากนำศักยภาพนี้มาประยุกต์ใช้กับข่าวลวงทางการเมืองหรือสังคม การสร้างคลิปปลอมที่ใส่ร้ายป้ายสีบุคคลหรือกลุ่มคนใดกลุ่มคนหนึ่ง อาจกระตุ้นให้เกิดความโกรธแค้นและนำไปสู่การใช้ความรุนแรงในโลกแห่งความเป็นจริงได้ เช่น การสร้างข่าวปลอมว่ากลุ่มชาติพันธุ์หนึ่งกำลังวางแผนทำร้ายคนในพื้นที่ หรือการสร้างคลิปนักเคลื่อนไหวทางสังคมยอมรับในสิ่งที่ไม่ได้ทำ ข้อมูลเท็จเหล่านี้เมื่อแพร่กระจายออกไปในวงกว้าง อาจกลายเป็นชนวนเหตุให้คนไทยทำร้ายกันเองโดยมีพื้นฐานมาจากข้อมูลที่ถูกปรุงแต่งขึ้นทั้งหมด

| ลักษณะ | ข่าวจริงจากสำนักข่าวที่น่าเชื่อถือ | ข่าวลวงจากผู้ประกาศ AI |

|---|---|---|

| แหล่งที่มาและการอ้างอิง | มีแหล่งข่าวชัดเจน ตรวจสอบได้ มีการอ้างอิงผู้ให้สัมภาษณ์หรือเอกสารประกอบ | มักไม่มีแหล่งที่มาที่ชัดเจน หรือแอบอ้างแหล่งข่าวปลอม ไม่สามารถตรวจสอบย้อนกลับได้ |

| คุณภาพวิดีโอและเสียง | มีความคมชัดสูง เสียงและภาพเป็นธรรมชาติ สอดคล้องกันอย่างสมบูรณ์ | อาจมีจุดผิดปกติ เช่น การขยับปากไม่ตรงกับเสียง, แสงเงาผิดเพี้ยน, หรือมีภาพกระตุกเล็กน้อย |

| เนื้อหาและวัตถุประสงค์ | นำเสนอข้อเท็จจริงอย่างรอบด้าน เป็นกลาง และมีวัตถุประสงค์เพื่อแจ้งข้อมูลข่าวสาร | มักมีเนื้อหาที่เร้าอารมณ์สุดโต่ง (เช่น ดีเกินจริง หรือเลวร้ายเกินจริง) มีเป้าหมายเพื่อหลอกลวงหรือปลุกปั่น |

| ช่องทางการเผยแพร่ | เผยแพร่ผ่านช่องทางที่เป็นทางการของสำนักข่าว เช่น เว็บไซต์หลัก, แอปพลิเคชัน, หรือโซเชียลมีเดียที่ยืนยันตัวตนแล้ว | มักแพร่กระจายผ่านเพจปลอม, บัญชีส่วนบุคคล, หรือกลุ่มปิดในโซเชียลมีเดีย |

แนวทางการรับมือและป้องกันในยุคดิจิทัล

บทบาทของภาครัฐและองค์กรสื่อ

การรับมือกับภัยคุกคามจากผู้ประกาศ AI จำเป็นต้องอาศัยความร่วมมือจากหลายภาคส่วน ภาครัฐมีบทบาทสำคัญในการออกมาตรการหรือแนวปฏิบัติเพื่อกำกับดูแลการพัฒนาและการใช้เทคโนโลยี AI อย่างมีความรับผิดชอบ โดยเฉพาะในอุตสาหกรรมสื่อสารมวลชน เพื่อป้องกันไม่ให้เทคโนโลยีนี้กลายเป็นเครื่องมือในการสร้างความขัดแย้งในสังคม นอกจากนี้ การสนับสนุนการวิจัยและพัฒนาเครื่องมือสำหรับตรวจจับ Deepfake ก็เป็นอีกหนึ่งภารกิจที่สำคัญ

ในขณะเดียวกัน องค์กรสื่อเองก็ต้องปรับตัวและสร้างมาตรฐานทางจริยธรรมที่เข้มแข็งขึ้น การจัดตั้งหน่วยงานตรวจสอบข้อเท็จจริง (Fact-Checking) เช่น Thai PBS Verify เป็นตัวอย่างที่ดีในการต่อสู้กับข้อมูลบิดเบือน สำนักข่าวควรมีความโปร่งใสในการนำ AI มาใช้ในกระบวนการผลิตข่าว และต้องให้ความรู้แก่ประชาชนเกี่ยวกับวิธีการแยกแยะข่าวจริงออกจากข่าวปลอมที่สร้างโดย AI

การสร้างภูมิคุ้มกันดิจิทัลสำหรับประชาชน

เกราะป้องกันที่ดีที่สุดในสงครามข้อมูลข่าวสารคือพลเมืองที่มีความรู้เท่าทันสื่อ (Media and Information Literacy) การปลูกฝังทักษะการคิดเชิงวิพากษ์ (Critical Thinking) เป็นสิ่งจำเป็นอย่างยิ่ง ประชาชนควรถูกสอนให้ตั้งคำถามกับข้อมูลที่ได้รับเสมอ เช่น “ใครคือผู้สร้างสารนี้?”, “พวกเขามีวัตถุประสงค์อะไร?”, “มีหลักฐานอื่นที่สนับสนุนหรือขัดแย้งกับข้อมูลนี้หรือไม่?”

ก่อนที่จะเชื่อหรือแบ่งปันข้อมูลใดๆ โดยเฉพาะคลิปวิดีโอที่ดูน่าตกใจหรือดีเกินจริง ควรตรวจสอบจากแหล่งข่าวที่น่าเชื่อถือหลายๆ แหล่งก่อนเสมอ การสังเกตความผิดปกติเล็กๆ น้อยๆ ในวิดีโอ เช่น การกะพริบตาที่ไม่เป็นธรรมชาติ หรือความไม่สอดคล้องกันของแสงเงา ก็อาจเป็นสัญญาณบ่งชี้ว่าเป็นคลิป Deepfake ได้ การสร้างสังคมแห่งการตรวจสอบและไม่ด่วนสรุป จะเป็นภูมิคุ้มกันที่แข็งแกร่งที่สุดในการป้องกันผลกระทบจากข่าวลวง AI

บทสรุป: การก้าวข้ามความท้าทายของข่าวลวง AI

ปรากฏการณ์ ผู้ประกาศ AI! สร้างข่าวลวง ทำคนไทยฆ่ากันเอง ไม่ใช่เพียงหัวข้อข่าวที่เกินจริง แต่เป็นภาพสะท้อนของความท้าทายที่สังคมไทยและทั่วโลกกำลังเผชิญ เทคโนโลยี Deepfake ได้เปลี่ยนโฉมหน้าของสงครามข้อมูลข่าวสาร ทำให้การสร้างเรื่องเท็จมีความน่าเชื่อถือและอันตรายกว่าที่เคยเป็นมา ผลกระทบของมันไม่ได้จำกัดอยู่แค่ความเสียหายทางการเงิน แต่ลุกลามไปถึงการบ่อนทำลายความไว้เนื้อเชื่อใจในสังคม และมีศักยภาพที่จะจุดชนวนความขัดแย้งรุนแรง

การแก้ไขปัญหานี้ไม่สามารถพึ่งพาฝ่ายใดฝ่ายหนึ่งได้ แต่ต้องอาศัยแนวทางแบบองค์รวม ตั้งแต่การมีกฎระเบียบที่รัดกุมจากภาครัฐ ความรับผิดชอบทางจริยธรรมขององค์กรสื่อ ไปจนถึงการสร้างเกราะป้องกันที่สำคัญที่สุด นั่นคือพลเมืองที่มีวิจารณญาณและรู้เท่าทันเทคโนโลยี การตระหนักรู้และตรวจสอบข้อมูลอย่างรอบคอบก่อนเชื่อและแบ่งปันต่อ คือทักษะการเอาตัวรอดที่จำเป็นอย่างยิ่งในยุคดิจิทัล เพื่อปกป้องทั้งตนเองและสังคมจากภัยเงียบที่พร้อมจะสร้างความแตกแยกได้ทุกเมื่อ