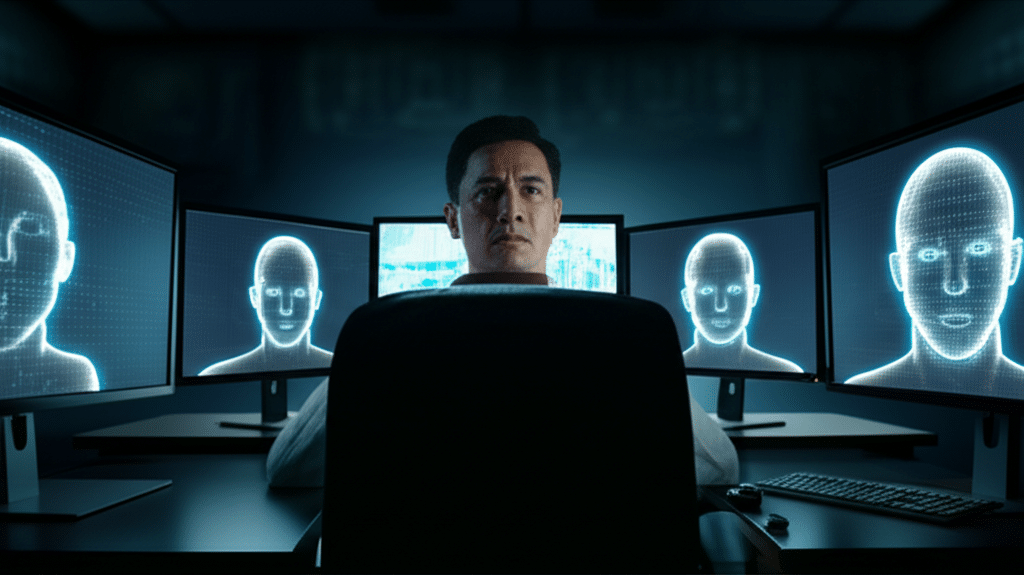

ระวัง! AI โคลนตัวตนออนไลน์ ภัยใหม่ใกล้ตัว

ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) พัฒนาไปอย่างก้าวกระโดด ประเด็นเรื่อง ระวัง! AI โคลนตัวตนออนไลน์ ภัยใหม่ใกล้ตัว ได้กลายเป็นหัวข้อที่ต้องให้ความสำคัญอย่างเร่งด่วน การสร้าง “Digital Clone” หรือ “โคลนนิ่งดิจิทัล” ซึ่งเป็นการจำลองตัวตนของบุคคลในโลกออนไลน์ ตั้งแต่เสียงไปจนถึงรูปลักษณ์ กำลังทวีความซับซ้อนและสมจริงขึ้นทุกวัน เทคโนโลยีนี้แม้จะมีประโยชน์ในบางแง่มุม แต่ก็มาพร้อมกับความเสี่ยงด้านความปลอดภัยไซเบอร์ที่อาจส่งผลกระทบต่อข้อมูลส่วนบุคคลและความมั่นคงในชีวิตประจำวันอย่างไม่เคยปรากฏมาก่อน

ประเด็นสำคัญเกี่ยวกับภัย AI โคลนนิ่ง

- เทคโนโลยี AI ในปัจจุบันสามารถสร้างเสียงโคลนที่เหมือนจริงได้อย่างน่าทึ่ง โดยใช้ข้อมูลเสียงต้นแบบเพียงไม่กี่นาทีเท่านั้น

- การโคลนตัวตนดิจิทัลไม่ได้จำกัดอยู่แค่ในวงการภาพยนตร์อีกต่อไป แต่ได้กลายเป็นเครื่องมือของมิจฉาชีพที่ใช้ในการหลอกลวงและสร้างข่าวปลอมแล้วในชีวิตจริง

- ข้อมูลส่วนบุคคลที่เปิดเผยบนโลกออนไลน์ เช่น คลิปเสียง วิดีโอ หรือข้อความ กลายเป็นวัตถุดิบสำคัญที่ AI สามารถนำไปใช้สร้างตัวตนปลอมได้

- การป้องกันเบื้องต้นที่ทุกคนทำได้คือการเพิ่มความระมัดระวังในการแบ่งปันข้อมูล และสร้างเกราะป้องกัน เช่น การตั้งรหัสลับกับคนในครอบครัวเพื่อยืนยันตัวตน

- ความตระหนักรู้และการติดตามข่าวสารด้านความปลอดภัยไซเบอร์เป็นสิ่งจำเป็นอย่างยิ่ง เพื่อให้เท่าทันกลโกงและภัยคุกคามรูปแบบใหม่ๆ ที่มาพร้อมกับเทคโนโลยี AI

ทำความรู้จัก Digital Clone: เทคโนโลยีดาบสองคม

คำว่า “Digital Clone” หรือ “โคลนนิ่งดิจิทัล” หมายถึงกระบวนการใช้เทคโนโลยีปัญญาประดิษฐ์ขั้นสูงเพื่อสร้างแบบจำลองดิจิทัลของบุคคลใดบุคคลหนึ่งขึ้นมา แบบจำลองนี้สามารถเลียนแบบคุณลักษณะเฉพาะตัวได้อย่างแม่นยำ ไม่ว่าจะเป็นน้ำเสียง ลีลาการพูด ลักษณะทางกายภาพ หรือแม้กระทั่งรูปแบบการเขียนและการแสดงความคิดเห็น เทคโนโลยีนี้เกิดขึ้นจากการที่ AI ได้เรียนรู้จากข้อมูลจำนวนมหาศาล (Big Data) ที่เกี่ยวข้องกับบุคคลเป้าหมาย ซึ่งข้อมูลเหล่านี้อาจมาจากแหล่งต่างๆ บนอินเทอร์เน็ตที่เจ้าของข้อมูลได้เคยเปิดเผยไว้

เทคโนโลยีนี้มีความสำคัญอย่างยิ่งในยุคปัจจุบัน เพราะมันสะท้อนถึงศักยภาพอันไร้ขีดจำกัดของ AI ในด้านหนึ่ง Digital Clone มีประโยชน์มหาศาล เช่น เทคโนโลยี “My Own Voice” ที่ถูกพัฒนาขึ้นเพื่อช่วยเหลือผู้ป่วยที่สูญเสียความสามารถในการพูด ให้สามารถสื่อสารด้วยเสียงสังเคราะห์ที่ยังคงเอกลักษณ์ของเสียงเดิมของตนเองไว้ได้ หรือการสร้าง AI Avatar เพื่อใช้เป็นผู้ช่วยเสมือนจริงในงานบริการลูกค้า ซึ่งช่วยลดภาระงานและเพิ่มประสิทธิภาพการทำงานได้

อย่างไรก็ตาม อีกด้านหนึ่งของคมดาบคือความเสี่ยงที่น่ากังวล ผู้ที่ไม่หวังดีสามารถนำเทคโนโลยีนี้ไปใช้ในทางที่ผิดได้อย่างง่ายดาย ไม่ว่าจะเป็นการสร้างข่าวปลอมที่น่าเชื่อถือ การปลอมแปลงตัวตนเพื่อฉ้อโกงทางการเงิน หรือแม้กระทั่งการกลั่นแกล้งทางไซเบอร์ ทุกคนที่มีตัวตนบนโลกออนไลน์จึงตกเป็นกลุ่มเสี่ยงโดยไม่รู้ตัว เพราะข้อมูลที่เคยโพสต์หรือแบ่งปันอาจกลายเป็นวัตถุดิบชั้นดีในการสร้าง “ร่างโคลน” ของตนเองขึ้นมาเพื่อวัตถุประสงค์ร้ายได้ทุกเมื่อ

ภัยคุกคามจาก AI โคลนนิ่งดิจิทัล: มากกว่าแค่การเลียนเสียง

ภัยคุกคามจากการโคลนตัวตนด้วย AI นั้นขยายวงกว้างและมีความซับซ้อนมากกว่าที่หลายคนคิด ไม่ได้จำกัดอยู่แค่การเลียนแบบเสียงเพียงอย่างเดียว แต่ยังครอบคลุมถึงการปลอมแปลงตัวตนในทุกมิติ ซึ่งสร้างความท้าทายอย่างยิ่งต่อการแยกแยะระหว่างความเป็นจริงและความเท็จในโลกดิจิทัล

การโคลนเสียงด้วย AI: ความสมจริงที่น่าตกใจ

หนึ่งในรูปแบบที่น่ากังวลที่สุดคือการโคลนเสียง (Voice Cloning) ความก้าวหน้าของ AI ทำให้การสร้างเสียงสังเคราะห์ที่เหมือนกับเสียงของบุคคลเป้าหมายแทบจะ неотличим จากเสียงจริงนั้นเป็นไปได้โดยใช้ข้อมูลเพียงเล็กน้อย จากข้อมูลการวิจัยพบว่า AI บางระบบต้องการไฟล์เสียงตัวอย่างที่มีความยาวเพียง 3 นาทีเท่านั้น ก็สามารถวิเคราะห์และจับลักษณะเฉพาะของเสียงได้อย่างครบถ้วน ทั้งโทนเสียงสูงต่ำ จังหวะการพูด สำเนียง และแม้กระทั่งอารมณ์ที่แฝงอยู่ในน้ำเสียง

กรณีศึกษาที่เกิดขึ้นจริงและสร้างความตื่นตัวไปทั่วโลก คือการใช้ AI โคลนเสียงของบุคคลสำคัญทางการเมือง เช่น ประธานาธิบดีสหรัฐฯ โจ ไบเดน เพื่อสร้างข้อความเสียงอัตโนมัติ (Robocall) ส่งไปยังผู้มีสิทธิ์เลือกตั้ง โดยมีเนื้อหาชักจูงให้ไม่ไปใช้สิทธิ์เลือกตั้ง เหตุการณ์นี้แสดงให้เห็นว่าภัยจาก AI โคลนเสียงไม่ได้เป็นเพียงทฤษฎี แต่เป็นภัยคุกคามที่เกิดขึ้นจริงและสามารถส่งผลกระทบต่อสังคมในวงกว้างได้

ความสมจริงของเสียงที่ถูกโคลนขึ้นมานี้เป็นอันตรายอย่างยิ่ง เพราะมันสามารถทำลายกำแพงความไว้วางใจที่มนุษย์มีต่อการสื่อสารด้วยเสียงได้โดยสิ้นเชิง เมื่อเราได้ยินเสียงของคนในครอบครัวหรือเพื่อนสนิทโทรมาขอความช่วยเหลือ เรามักจะเชื่อโดยไม่ลังเล ซึ่งนี่คือช่องโหว่ที่มิจฉาชีพใช้เป็นเครื่องมือในการหลอกลวง

รูปแบบการหลอกลวงที่พบบ่อยจาก AI Avatar

การใช้ AI สร้างตัวตนปลอม หรือ AI Avatar เพื่อการหลอกลวงมีหลากหลายรูปแบบ โดยอาศัยหลักการทางจิตวิทยาเพื่อสร้างความน่าเชื่อถือและกดดันให้เหยื่อหลงเชื่อ รูปแบบที่พบบ่อยที่สุดคือการหลอกลวงทางโทรศัพท์ (Vishing – Voice Phishing) ซึ่งมีขั้นตอนดังนี้:

- การรวบรวมข้อมูล: มิจฉาชีพจะรวบรวมข้อมูลเสียงของเป้าหมายจากแหล่งต่างๆ เช่น คลิปวิดีโอในโซเชียลมีเดีย, พอดแคสต์, หรือแม้กระทั่งข้อความเสียงที่เคยฝากไว้

- การสร้างเสียงโคลน: นำข้อมูลเสียงที่รวบรวมได้ไปป้อนเข้าสู่ระบบ AI เพื่อสร้างแบบจำลองเสียงที่เหมือนจริง

- การสร้างสถานการณ์ฉุกเฉิน: มิจฉาชีพจะใช้เสียงโคลนโทรศัพท์ไปยังคนใกล้ชิดของเป้าหมาย เช่น พ่อแม่ หรือเพื่อนสนิท โดยสร้างเรื่องราวที่น่าตกใจและเร่งด่วน เช่น “แม่ครับ ผมโดนจับ ต้องการเงินประกันตัวด่วน” หรือ “นี่เพื่อนเองนะ รถเกิดอุบัติเหตุ ช่วยโอนเงินค่าซ่อมให้ก่อน”

- การใช้จิตวิทยากดดัน: ความตื่นตระหนกจากการได้ยินเสียงของคนรักกำลังตกอยู่ในอันตราย ทำให้เหยื่อขาดความสามารถในการไตร่ตรองและมีแนวโน้มที่จะทำตามคำขอโดยทันที

นอกจากการหลอกลวงทางการเงินแล้ว ภัยคุกคามยังรวมถึงการสร้างข้อมูลบิดเบือนเพื่อทำลายชื่อเสียง การแบล็กเมล์ หรือการแทรกแซงทางการเมือง ซึ่งทั้งหมดนี้ล้วนบั่นทอนความมั่นคงปลอดภัยของสังคมโดยรวม

ตารางเปรียบเทียบภัยคุกคามจาก AI โคลนตัวตน

| ประเภทของภัยคุกคาม | วิธีการของมิจฉาชีพ | ตัวอย่างผลกระทบ |

|---|---|---|

| การโคลนเสียง (Voice Cloning) | ใช้ AI สร้างเสียงเลียนแบบบุคคลเป้าหมาย แล้วโทรศัพท์ไปหลอกลวงคนใกล้ชิดโดยอ้างสถานการณ์ฉุกเฉิน | การสูญเสียทรัพย์สินจากการหลอกให้โอนเงิน, ความเข้าใจผิดในครอบครัว, การสร้างข่าวปลอมทางการเมือง |

| การสร้างภาพและวิดีโอปลอม (Deepfake) | ใช้ AI ตัดต่อใบหน้าของบุคคลเป้าหมายเข้าไปในวิดีโออื่น เพื่อสร้างสถานการณ์ที่ไม่ได้เกิดขึ้นจริง | การทำลายชื่อเสียง, การแบล็กเมล์, การสร้างหลักฐานเท็จ, การเผยแพร่ข้อมูลที่ไม่เหมาะสม |

| การปลอมแปลงข้อความ (Text Generation) | ใช้ AI เรียนรู้สไตล์การเขียนของบุคคลเป้าหมายจากอีเมลหรือโซเชียลมีเดีย เพื่อสร้างข้อความปลอม | การหลอกลวงทางธุรกิจ (Business Email Compromise), การสร้างความขัดแย้งระหว่างบุคคล, การส่งอีเมลฟิชชิ่งที่น่าเชื่อถือ |

แนวทางป้องกันและรับมือกับภัยโคลนนิ่งดิจิทัล

แม้ว่าภัยคุกคามจาก AI โคลนนิ่งจะดูน่ากลัวและรับมือได้ยาก แต่การสร้างความตระหนักรู้และปรับใช้มาตรการป้องกันขั้นพื้นฐานสามารถลดความเสี่ยงได้อย่างมีนัยสำคัญ การป้องกันที่ดีที่สุดคือการเริ่มต้นจากพฤติกรรมการใช้งานอินเทอร์เน็ตของตนเองและสร้างเกราะป้องกันให้กับคนในครอบครัว

จำกัดการเปิดเผยข้อมูลส่วนบุคคลทางออนไลน์

ข้อมูลส่วนบุคคลเปรียบเสมือนวัตถุดิบที่ AI ใช้ในการเรียนรู้และสร้างตัวตนโคลน ยิ่งเปิดเผยข้อมูลมากเท่าไหร่ AI ก็ยิ่งเรียนรู้และสร้างแบบจำลองที่สมจริงได้มากขึ้นเท่านั้น ดังนั้น การทบทวนและจำกัดการเปิดเผยข้อมูลจึงเป็นด่านแรกของการป้องกัน

- ทบทวนการตั้งค่าความเป็นส่วนตัว: ตรวจสอบการตั้งค่าความเป็นส่วนตัวบนบัญชีโซเชียลมีเดียทั้งหมด จำกัดการเข้าถึงโพสต์ รูปภาพ และวิดีโอให้เห็นเฉพาะเพื่อนหรือคนที่ไว้ใจ

- คิดก่อนโพสต์: ก่อนจะโพสต์คลิปวิดีโอหรือคลิปเสียงที่มีเสียงของตนเอง ควรตระหนักว่าข้อมูลเหล่านั้นอาจถูกนำไปใช้ในทางที่ผิดได้

- ระวังการให้ข้อมูลกับแพลตฟอร์มที่ไม่น่าเชื่อถือ: หลีกเลี่ยงการเข้าร่วมกิจกรรมหรือใช้แอปพลิเคชันที่ขอเข้าถึงข้อมูลส่วนตัวมากเกินความจำเป็น

สร้าง “รหัสลับ” สำหรับครอบครัวและคนใกล้ชิด

นี่เป็นหนึ่งในวิธีที่เรียบง่ายแต่มีประสิทธิภาพสูงในการรับมือกับการหลอกลวงทางโทรศัพท์ที่ใช้เสียงโคลน แนวคิดคือการตกลงใช้ “คำถามหรือรหัสลับ” (Safeword/Safe Question) ที่มีเพียงคนในครอบครัวหรือกลุ่มเพื่อนสนิทเท่านั้นที่รู้คำตอบ

ตัวอย่างเช่น หากได้รับโทรศัพท์ที่น่าสงสัยจากบุคคลที่อ้างว่าเป็นคนในครอบครัวและกำลังเดือดร้อน ให้ถามคำถามที่ตกลงกันไว้ เช่น “ตอนไปเที่ยวทะเลครั้งล่าสุด เราพักที่ไหน” หรือ “ชื่อเล่นของสุนัขตัวแรกของเราคืออะไร” หากผู้ที่โทรมาไม่สามารถตอบได้ หรือตอบอย่างลังเล ก็เป็นสัญญาณที่ชัดเจนว่าอาจเป็นการหลอกลวง วิธีนี้จะช่วยให้สามารถยืนยันตัวตนของผู้ที่ติดต่อมาได้อย่างรวดเร็วและมีประสิทธิภาพก่อนที่จะตัดสินใจให้ความช่วยเหลือใดๆ

ตรวจสอบและยืนยันก่อนเชื่อเสมอ

หลักการ “ไม่ไว้วางใจโดยไม่มีการยืนยัน” (Zero Trust) ควรถูกนำมาปรับใช้ในชีวิตประจำวัน เมื่อได้รับการติดต่อที่น่าสงสัย ไม่ว่าจะผ่านช่องทางใดก็ตาม โดยเฉพาะอย่างยิ่งเมื่อมีการร้องขอเรื่องเงินหรือข้อมูลที่ละเอียดอ่อน ควรหยุดและทำการตรวจสอบก่อนเสมอ

- วางสายแล้วโทรกลับ: หากได้รับสายที่น่าสงสัย ให้วางสายแล้วโทรกลับไปยังเบอร์โทรศัพท์ของบุคคลนั้นที่บันทึกไว้ในรายชื่อผู้ติดต่อของตนเอง ไม่ใช่โทรกลับไปยังเบอร์ที่เพิ่งโทรเข้ามา

- ยืนยันผ่านช่องทางอื่น: ลองติดต่อบุคคลนั้นผ่านช่องทางการสื่อสารอื่น เช่น ส่งข้อความผ่านแอปพลิเคชันแชท หรือติดต่อสมาชิกในครอบครัวคนอื่นเพื่อสอบถามสถานการณ์

- แจ้งเจ้าหน้าที่: หากสงสัยว่ากำลังตกเป็นเป้าหมายของมิจฉาชีพ ควรแจ้งเจ้าหน้าที่ที่เกี่ยวข้องเพื่อลงบันทึกและป้องกันไม่ให้ผู้อื่นตกเป็นเหยื่อต่อไป

ติดตามข่าวสารด้านความปลอดภัยไซเบอร์อย่างสม่ำเสมอ

ภัยคุกคามทางไซเบอร์มีการพัฒนาและเปลี่ยนแปลงรูปแบบอยู่ตลอดเวลา การติดตามข่าวสารและแนวทางการป้องกันจากแหล่งข้อมูลที่น่าเชื่อถือจะช่วยให้เท่าทันกลโกงใหม่ๆ และสามารถปรับตัวเพื่อรับมือได้อย่างเหมาะสม การมีความรู้และความเข้าใจในเรื่องนี้ไม่เพียงแต่จะช่วยป้องกันตนเองได้ แต่ยังสามารถนำไปแบ่งปันและเตือนคนรอบข้างให้ปลอดภัยได้อีกด้วย

บทสรุป: อนาคตของตัวตนดิจิทัลและความท้าทาย

เทคโนโลยี AI โคลนตัวตนออนไลน์ หรือ Digital Clone ได้ก้าวข้ามจากนิยายวิทยาศาสตร์มาสู่ความเป็นจริงในปัจจุบัน และได้สร้างความท้าทายใหม่ให้กับความปลอดภัยไซเบอร์อย่างหลีกเลี่ยงไม่ได้ เส้นแบ่งระหว่างตัวตนจริงและตัวตนปลอมในโลกดิจิทัลเริ่มเลือนลางลง ทำให้การตรวจสอบและยืนยันความถูกต้องกลายเป็นเรื่องที่ซับซ้อนยิ่งขึ้น ภัยคุกคามนี้ไม่ได้ส่งผลกระทบต่อความมั่นคงทางการเงินเพียงอย่างเดียว แต่ยังสั่นคลอนความไว้วางใจซึ่งเป็นรากฐานสำคัญของสังคม

ในขณะที่การพัฒนาเทคโนโลยี AI ยังคงดำเนินต่อไปอย่างไม่หยุดยั้ง การป้องกันภัยคุกคามที่มาพร้อมกันนั้นจึงไม่ใช่หน้าที่ของหน่วยงานใดหน่วยงานหนึ่ง แต่เป็นความรับผิดชอบร่วมกันของทุกคนในสังคม การสร้างความตระหนักรู้ การปลูกฝังพฤติกรรมการใช้งานอินเทอร์เน็ตอย่างปลอดภัย และการปรับใช้วิธีป้องกันอย่างจริงจัง เช่น การจำกัดการแชร์ข้อมูล และการสร้างกลไกยืนยันตัวตนกับคนใกล้ชิด จึงเป็นเกราะป้องกันที่ดีที่สุดที่จะช่วยให้เราสามารถก้าวผ่านความท้าทายในยุคดิจิทัลที่ซับซ้อนนี้ไปได้อย่างปลอดภัย